Ero indeciso se pubblicare o meno l’articolo che segue. E’ lungo, di non facile lettura, di scarso interesse per studentesse e studenti liceali, è tradotto in modo automatico (mi scuso già per refusi o errori). A questo punto ho perso il 95% dei lettori. L’ho scoperto attraverso la puntata “La politica quantistica” del podcast “Fuori da qui” di Simone Pieranni. E’ a firma dello scrittore e storico Anton Cebalo e compare su Noemamag (a cura del Berggruen Institute, una rete globale di pensatori che elaborano soluzioni sistemiche alle sfide globali). Ho deciso di pubblicarlo perché per me è stato un piacere per la mente leggerlo. Tutto qui, e appuntarlo sul blog significa aver la possibilità di recuperarlo facilmente.

L’articolo analizza l’attuale crisi della democrazia, in particolare statunitense, non come un problema ideologico, ma come un diffuso fervore antipolitico causato dal crollo dell’appartenenza sociale. Storicamente, partiti e istituzioni erano radicati in comunità solide (chiese, sindacati, vita locale); oggi, il declino di questi legami ha lasciato il posto a un “vuoto” governato da élite isolate e “cartellizzate”. Questo sentimento, amplificato da Internet e dalla sfiducia verso la mediazione tradizionale, trasforma il cinismo in “rabbia perseguibile”, portando al successo di outsider populisti che però faticano a mantenere la legittimità una volta al potere. Attraverso parallelismi storici — dalle crisi post-belliche di Gramsci all’antipolitica dei dissidenti dell’Est Europa — Cebalo suggerisce che l’attuale opposizione al “leviatano democratico” sia un sintomo di una trasformazione profonda. La sfida futura non sarà tornare al passato, ma ricostruire una società civile dal basso che renda i cittadini nuovamente visibili e partecipi.

Ma ecco l’articolo intero.

UN NUOVO FERVORE ANTIPOLITICO

Come il crollo dell’appartenenza politica sta rimodellando la democrazia.

“Si dice che viviamo in una crisi della democrazia, ma sarebbe più corretto dire che viviamo in una crisi della politica. In tutto il mondo, e soprattutto in Occidente, si è diffuso un clima antipolitico.

La fiducia in diverse istituzioni nazionali chiave è ai minimi storici negli Stati Uniti. Per molti elettori, gli outsider politici sono più convincenti dei politici esperti. La rabbia verso le élite è comune con l’aumento della disuguaglianza di reddito. Il clima sociale sta diventando più solitario e logoro. La vita comunitaria ha sofferto, peggiorata dall’uso di Internet. Ci fidiamo meno gli uni degli altri e siamo più ansiosi e pessimisti riguardo al futuro.

Per gran parte del XX secolo, la politica e persino i partiti politici erano visti da molti come una casa fuori casa, rafforzata da solide basi sociali di sostegno. Sindacati, chiese, organizzazioni civiche e la vita della comunità locale ne costituivano il fondamento. Questo radicamento creava sia una stabilità gestibile per lo Stato, sia un significato per le persone.

Da allora, questi luoghi di appartenenza sono andati in declino, e così anche la politica come casa. Ciò che è emerso in risposta è un pubblico disorientato e diffidente. Storicamente, periodi di transizione di grande disgregazione economica e sociale come il nostro sono anche periodi di accresciuti sentimenti antipolitici. Le persone comuni diventano distaccate e persino sospettose nei confronti dei loro rappresentanti pubblici.

Ciò che rende straordinaria la situazione odierna è la forza con cui i sentimenti antipolitici sono cresciuti contemporaneamente in molti paesi diversi. Recenti sondaggi mostrano un’insoddisfazione nei confronti della democrazia in 12 delle principali nazioni ad alto reddito, con una mediana del 64%, un livello record. Queste tendenze si estendono ben oltre il mondo occidentale. Il 2025 ha visto rivolte senza precedenti in Asia, motivate da un forte senso di disgusto verso i politici e il nepotismo. Una rabbia simile ha alimentato proteste in Kenya, Marocco, Madagascar e altrove in Africa.

I politici e le élite si ritrovano ora a “governare il vuoto”, per usare le parole del teorico politico Peter Mair.

Al giorno d’oggi, i sentimenti antipolitici tendono a manifestarsi a macchia d’olio. Solitamente online, i movimenti prendono rapidamente forma, si organizzano e spesso si dissolvono con la stessa rapidità con cui sono apparsi. Uniti dalla comune sfiducia nella classe politica, le proteste del 15-M in Spagna, Occupy Wall Street e la Primavera Araba sono stati alcuni dei primi movimenti a macchia d’olio basati principalmente su Internet negli anni 2010. “Né-né” e “Abbasso la dittatura partitocratica” erano slogan comuni degli indignados in Spagna nel 2011.

Più di recente, i Gilet Gialli si sono formati in Francia nel 2018 come un gruppo decentralizzato contro lo Stato. Questi gruppi hanno persino rovesciato governi, come in Armenia nel 2018, in Bangladesh nel 2024 e in Nepal nel 2025. Anche candidati esterni hanno abbracciato il clima antipolitico per salire al potere, con risultati alterni.

Nell’ultimo decennio, la destra populista ha avuto più successo sfruttando il clima antipolitico. Ma l’antipolitica è un’energia pubblica grezza, svincolata da alcuna ideologia politica. Sta ridefinendo l’intero scenario politico. L’antipolitica, come scrisse l’editorialista del New York Times David Brooks nel 2016, è davvero il “cancro dominante del nostro tempo”? O è piuttosto la risposta immunitaria della società contro i fallimenti dello Stato, sintomo di una trasformazione più profonda?

Sebbene periodi di fervore antipolitico abbiano preso piede con altrettanta forza in passato, la nostra situazione odierna è unica. Ci sono due momenti storici che possono aiutarci a comprendere le motivazioni dell’attuale frustrazione e a distinguerla. Attraverso questa cornice, possiamo contestualizzare meglio il caso degli Stati Uniti e anche comprendere quale futuro potrebbe derivarne.

L’antipolitica è un veicolo di malcontento, uno spirito reale ma disorganizzato del nostro tempo, e la sua destinazione è una questione aperta.

Dopo la prima guerra mondiale

Mentre era detenuto in una prigione italiana dai fascisti negli anni ‘30, il filosofo e politico Antonio Gramsci scrisse che “a un certo punto della loro vita storica, le classi sociali si staccano dai loro partiti tradizionali”.

Quando le élite al potere perdono il loro consenso, ha continuato, “non sono più ‘leader’ ma solo ‘dominanti’… questo significa precisamente che le grandi masse si sono staccate dalle loro ideologie tradizionali e non credono più a ciò in cui credevano prima”.

Questa intuizione era la prefazione a un adattamento delle sue parole spesso citato: Sono tempi in cui “il vecchio muore e il nuovo lotta per nascere”. È anche il momento in cui si manifesta una “grande varietà di sintomi morbosi”.

Gramsci stava diagnosticando un clima sociale emerso dalla Prima Guerra Mondiale. La Grande Guerra aveva causato una perdita di abitazione e di vite umane senza precedenti. Imperi secolari come quello della dinastia asburgica d’Austria-Ungheria e dell’Impero Ottomano crollarono. Nuovi stati emersero dalle macerie e la vita in quelli sopravvissuti fu cambiata per sempre.

Poiché tutto era così malconcio, gli anni tra le due guerre mondiali furono un periodo di intensa lotta politica di massa in Europa. La gente era alla ricerca di un’identità e cercava disperatamente risposte su come ricominciare.

Molti all’epoca si pronunciarono apertamente contro la democrazia parlamentare. Le democrazie del primo dopoguerra furono costruite in fretta e non furono in grado di far fronte all’ondata di richieste popolari. Piene di fazioni e di rimostranze storiche, erano intrinsecamente instabili.

La democrazia parlamentare, quindi, divenne un facile bersaglio per la frustrazione. Nel suo “La rivolta delle masse”, il filosofo spagnolo José Ortega y Gasset, nel 1929, paragonò l’umore antipolitico delle masse a una “mera negazione”. La crisi della politica, allora, fu principalmente incanalata da due movimenti di massa: comunisti e fascisti.

Furono i fascisti ad avere il maggior successo nel convertire questo sentimento antipolitico in potere. Alla fine degli anni ‘30, la crisi politica aveva trasformato il continente europeo. Nel 1938, solo 13 stati europei erano democrazie parlamentari, in calo rispetto ai 26 del 1920.

I danni causati dai partiti di massa radicali spinsero la filosofa Simone Weil a scrivere “Sull’abolizione di tutti i partiti politici” nel 1943. Concluse che il fine logico di ogni partito è il monopolio del potere a spese della società. L’obiettivo finale di un partito, scrisse, “è la sua crescita, senza limiti”.

Il clima sociale rimase diffidente e cinico fino alla Seconda Guerra Mondiale inoltrata. Nel suo “Il mondo di ieri”, pubblicato nel 1941, lo scrittore austriaco Stefan Zweig osservò l’Europa e trovò pessimismo ovunque:

Nel 1939… questa fede quasi religiosa nell’onestà o almeno nella capacità del proprio governo era scomparsa in tutta Europa. Non si provava altro che disprezzo per la diplomazia dopo che l’opinione pubblica aveva assistito, con amarezza, alla distruzione di ogni possibilità di una pace duratura a Versailles.

In fondo, nessuno rispettava gli statisti del 1939, e nessuno affidava loro il proprio destino con serenità. Le nazioni ricordavano chiaramente quanto fossero state spudoratamente tradite con promesse di disarmo e di abolizione di accordi diplomatici segreti… Dove, si chiedevano, ci porteranno ora?

La triste ironia di quel periodo è che l’opinione pubblica, che era diventata così cinica nei confronti della politica parlamentare, si ritrovò a dover sfruttare nuovamente le proprie frustrazioni e a dover decidere il proprio destino, proprio come nel 1914. Non ebbe altra scelta che adeguarsi.

“Gli uomini andarono al fronte, ma non sognando di diventare eroi”, scrisse Zweig. “Nazioni e individui si sentivano vittime o della comune follia politica o del potere di un destino incomprensibile e malvagio”.

Sotto la cortina di ferro

A differenza dei turbolenti anni tra le due guerre, dopo la Seconda guerra mondiale i sentimenti antipolitici furono costretti a nascondersi nell’Europa orientale. L’opinione pubblica fu oppressa da un culto del potere che regnava come un impenetrabile leviatano. Nel 1956, lo stato sovietico represse violentemente la rivolta popolare in Ungheria. Nel 1968, fece lo stesso in Cecoslovacchia.

Dopo quella tragedia, divenne chiaro a molti che la politica era un vicolo cieco. Secondo il dissidente ceco Václav Havel, anche se nessuno credeva nello Stato, bisognava “comportarsi come se ci credessero o tollerarli in silenzio”. Il dissidente polacco Jacek Kuroń catturò al meglio il concetto: “Cosa fare quando non si può fare nulla?”

Con ogni possibilità di cambiamento politico apparentemente chiusa, i dissidenti si interrogarono invece su come la vita dovesse essere vissuta e condivisa con gli altri. Rivolsero la loro attenzione alla società civile, formando un contro-movimento che lo scrittore ungherese György Konrád definì “antipolitica”.

L’antipolitica era un movimento sociale che cercava di creare uno spazio pubblico separato dallo Stato. Era conosciuto con molti nomi: “seconda cultura”, “polis parallela”, “politica dal basso”. Come disse Havel, il dissidente “non desidera una carica e non raccoglie voti. Non offre nulla e non promette nulla”.

L’antipolitica dell’Europa orientale era invece un progetto sociale: una critica morale del potere radicata nella vita quotidiana. Havel coniò il suo credo come “vivere nella verità”. Il giornalista polacco Konstanty Gebert descrisse il vivere nella verità come l’erezione di una “piccola barricata portatile tra me e il silenzio, la sottomissione, l’umiliazione, la vergogna”.

Non vedendo alcuna possibilità politica, i dissidenti ripensarono il loro modo di vivere con gli altri. Le loro riunioni si tenevano clandestinamente, in appartamenti e in riunioni di lavoro segrete. Sottolineavano che le loro azioni – persino il linguaggio – non erano politiche, ma pro-sociali. Iniziarono a creare una seconda cultura attraverso film, romanzi, poesie, musica e altri mezzi di comunicazione, esplorando le loro condizioni estreme. Oggi, questo è comunemente ricordato come l’età d’oro della letteratura e dell’arte dell’Europa orientale.

Alla fine, naturalmente, i dissidenti vinsero. Vinsero trasformando la sfera sociale in qualcosa in grado di colpire lo Stato. Con l’accumularsi delle crepe, il regime sovietico crollò sotto il peso della propria illegittimità. Alcuni scrittori ed eroi dell’underground antipolitico si candidarono a loro volta alle elezioni, nonostante le promesse iniziali.

Il caso dell’Europa orientale dimostra come l’antipolitica si reinventi con ogni nuova serie di circostanze materiali.

Oggi

Per gran parte del XX secolo, si è accettato che i partiti politici dovessero essere collegati alle organizzazioni della società civile per garantire l’affluenza alle urne e la legittimità. Questo ha reso i partiti più ricettivi alla pressione pubblica; dovevano dimostrare interesse per i risultati economici. I partiti facevano affidamento anche sul pubblico e sulle sue organizzazioni per finanziamenti e leadership.

Negli ultimi decenni, tuttavia, le organizzazioni della società civile si sono erose. Di conseguenza, i partiti odierni faticano a ottenere una partecipazione di massa duratura come un secolo fa. Inoltre, lo Stato non domina la vita pubblica in modo così punitivo, come sotto il regime sovietico, da rendere necessaria una seconda cultura.

Oggi le condizioni sono radicalmente diverse. Mentre il rapporto teso tra Stato e cittadini viene nuovamente rinegoziato, la sua espressione sarà unica nel suo genere, tipica del XXI secolo.

L’attuale clima antipolitico è in crescita da tempo. In “Governare il vuoto. La fine della democrazia dei partiti”, pubblicato nel 2013, Mair ha documentato l’insolita convergenza di tendenze in tutte le democrazie occidentali: bassa affluenza alle urne, calo degli iscritti ai partiti, aumento degli indipendenti, forti oscillazioni elettorali e scarsa partecipazione alle organizzazioni della società civile. Da allora, queste tendenze si sono approfondite e consolidate.

Oggi, gli elettori sono meno guidati da segnali di partito. Negli Stati Uniti, la pluralità non si identifica con nessuno dei due partiti principali. Di conseguenza, la correlazione tra classe sociale e preferenze degli elettori si è indebolita. I blocchi elettorali non si adattano più a schemi chiari e modelli predittivi come un tempo. Questo è il nuovo pubblico che Mair ha paragonato al “vuoto”.

La ragione di questi cambiamenti è di lunga data e strutturale, ma la frustrazione è stata amplificata da Internet. Come documentato da Martin Gurri in “The Revolt of the Public” del 2014, Internet ha minato i vecchi mediatori dell’informazione, quelli dall’alto verso il basso. I media tradizionali non stabiliscono più l’agenda in modo esclusivo e gli Stati non possono più governare efficacemente solo con la persuasione. Le narrazioni dominanti faticano a prevalere. Nelle parole di Gurri, questo significa che “ogni centimetro di spazio politico è conteso” in un ambiente mediatico orizzontale e decentralizzato.

L’esplosione di informazioni ha portato a un collasso del significato, sostituito dalla pura negazione. Come ha affermato sinteticamente il filosofo Byung-Chul Han in un’intervista del 2022 su Noema, “Più ci confrontiamo con le informazioni, più cresce il nostro sospetto”. Questo è il carburante naturale per l’antipolitica. Allo stesso modo, Gurri ha sostenuto che il fallimento del governo ora definisce l’agenda pubblica. Poiché il significato non può più essere narrativizzato dall’alto verso il basso, gli stati non sono in grado di nascondere o giustificare facilmente i propri fallimenti come in passato.

Invece di affermare il centro del potere, Internet dà energia al “mondo del molto piccolo”, per usare le parole dell’ex presidente armeno e fisico Armen Sarkissian. Ha paragonato gli effetti destabilizzanti di Internet alla meccanica quantistica: “Bastano un paio di particelle ad alta energia. Arrivano e colpiscono. E quello che si ottiene è una reazione a catena”.

Nel gennaio 2022, Sarkissian cadde vittima di questo stesso fenomeno, solo quattro anni dopo che un’ondata di attacchi informatici aveva rovesciato il governo armeno. Affermò che l’opinione pubblica era diventata ossessionata da “ogni sorta di teorie e miti del complotto”, il che stava iniziando a incidere negativamente sulla sua salute. In un annuncio a sorpresa, si dimise e affermò che la sua carica presidenziale non aveva sufficiente potere per influenzare gli eventi.

Tuttavia, l’idea che internet avrebbe aggravato il vuoto non era scontata. Come scrive Gurri, implicita nella lotta secolare per il suffragio era la convinzione che “una volta che tutte le persone fossero state all’interno del sistema, sarebbe successo qualcosa di magico: la buona società”. Un tempo, internet era vista semplicemente come un’estensione di questa lunga marcia verso l’inclusione, un’idea che avrebbe solo meglio rappresentato un interesse generale.

Internet ha invece messo in luce l’inerzia e il vuoto delle istituzioni politiche. Oggi, con ben poco di sacro rimasto, queste istituzioni vengono prontamente riempite da outsider opportunisti e altri imprenditori politici, che stanno anche plasmando il dibattito pubblico. Un certo cinismo è sempre stato parte integrante della società democratica, ma ora si trasforma facilmente in rabbia perseguibile.

Sebbene Internet abbia approfondito i sentimenti antipolitici, le condizioni sociali preesistenti hanno gettato le basi affinché ciò accadesse. Dagli anni ‘70, i partiti politici nelle democrazie occidentali si sono svuotati. Le loro organizzazioni sono diventate più chiuse e insulari, affidandosi sempre meno ai loro elettori per il processo decisionale e i finanziamenti. La rabbia odierna, quindi, non è frutto della fantasia, ma affonda le sue radici in un’esclusione di lunga data.

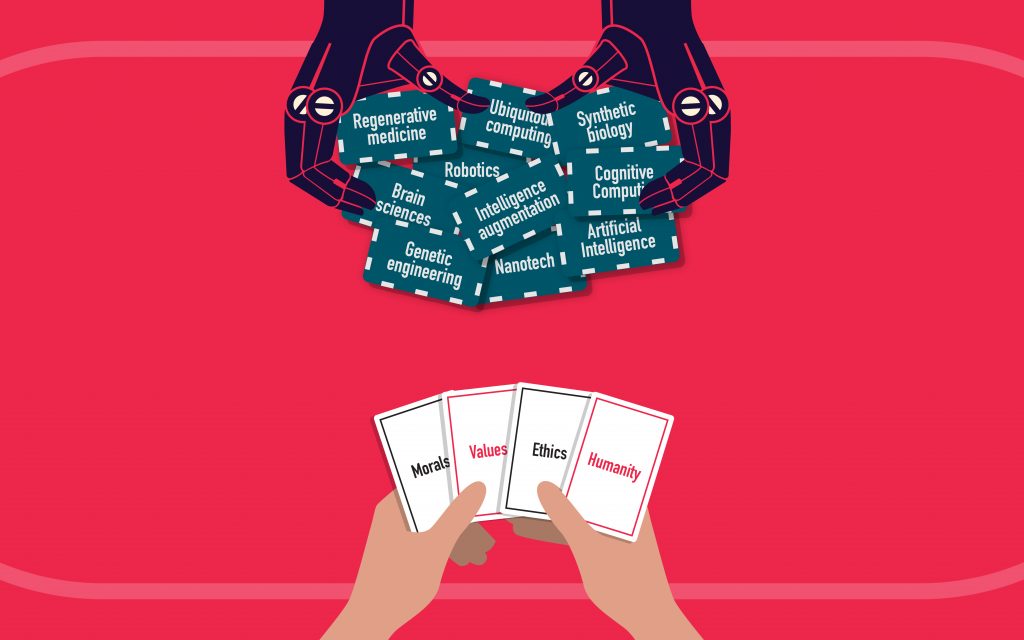

Mair e il politologo Richard S. Katz hanno sostenuto nel loro libro del 2018 che i principali partiti occidentali hanno subito un processo di “cartellizzazione”. Mentre i partiti di massa all’inizio del XX secolo erano ad alta intensità di lavoro, dal basso verso l’alto, riformisti e facevano affidamento sui membri per il finanziamento, i partiti di cartello considerano la politica una professione, dipendono da una classe benestante di donatori, possiedono una mentalità di gruppo e colludono tra loro per mantenere le proprie posizioni. Poiché i partiti di cartello fanno meno affidamento sul reclutamento di membri, esternalizzano invece il processo decisionale a burocrazie istituzionali, tribunali e una rete di organizzazioni esterne al governo.

Questi cambiamenti fanno sì che le persone comuni si sentano invisibili e secondarie. Prive di un rapporto diretto con il pubblico, le élite politiche sono sempre più legate solo a se stesse. Lo scopo principale dei partiti politici diventa quindi semplicemente il mantenimento delle proprie posizioni. Come ha osservato Mair, i partiti occidentali sono “diventati agenzie che governano piuttosto che rappresentare”. In questa dinamica, il ruolo del pubblico nella democrazia è in gran parte relegato a quello di spettatore.

Non sorprende che le urne siano diventate il veicolo naturale dell’antipolitica. Il voto può essere un improvviso promemoria per le élite politiche che il pubblico controlla ancora alcune leve. Negli ultimi anni, i movimenti populisti, sia di destra che di sinistra, hanno fatto leva su sentimenti antipolitici per spodestare i partiti tradizionalmente dominanti nell’Europa occidentale e oltre. Di fatto, il 2024 è stato l’anno peggiore mai registrato per i partiti in carica. Nei paesi sviluppati in cui si sono tenute elezioni, ogni singolo partito al governo ha perso quote di voto.

Il caso americano

La storia moderna degli Stati Uniti racconta decenni di come l’antipolitica si radichi. Alla fine degli anni ‘60, l’opinione pubblica divenne diffidente e si allontanò, mentre i partiti politici si isolarono per proteggersi.

A volte definito “l’ultimo anno innocente”, il 1964 fu il punto più alto della fiducia nelle istituzioni americane, con un 77%, secondo un sondaggio Gallup. Sia il fallimento della guerra in Vietnam che gli scandali di corruzione in patria – come il Watergate e le conclusioni del Comitato Church sugli abusi della CIA – danneggiarono profondamente la fiducia pubblica negli anni successivi. Nel 1979, era crollata al 29%.

Il pubblico rispose alle prospettive politiche in declino ripiegandosi su se stesso. Gli anni ‘70 furono il “Decennio dell’Io”, come lo definì il giornalista Tom Wolfe. Gli ex focolai di attivismo studentesco si placarono. Relativamente rari nel decennio precedente, i libri di auto-aiuto iniziarono a riempire le classifiche dei best-seller. Concetti come “burnout” apparvero per la prima volta sulle riviste di psicologia. Come scrisse Christopher Lasch a proposito di quel periodo, una “sensibilità terapeutica” stava prendendo il sopravvento in America. Gli americani non consideravano più la politica come un luogo in cui realizzare i propri sogni.

Invece, guardarono altrove. Ciò che un tempo era politico divenne personale. La sociologa Nina Eliasoph ha documentato come questa trasformazione abbia influenzato persino il linguaggio delle persone comuni. Nei suoi studi sul campo durante gli anni ‘80, rimase sorpresa nello scoprire quanto spesso parole come “fattibile” e “personale” si sovrapponessero a “non politico”, mentre “non fattibile” era associato a “lontano da casa” o “politico”. Alla fine del XX secolo, questa sensibilità passiva era evidente alle urne. Nelle elezioni presidenziali del 1996, l’affluenza alle urne scese a un minimo storico.

Ciò non era senza ragione. Con lo scoppio degli scandali degli anni ‘70, sia il Partito Repubblicano che quello Democratico si riorganizzarono, allontanandosi dal pubblico, giustificando questo cambiamento con la scusa della stabilità. Il pubblico era considerato semplicemente troppo volubile ed emotivo per decidere in politica.

Ciò diede origine alle cosiddette “primarie invisibili” o “primarie monetarie”: le primarie primarie, in cui un candidato viene preparato per il pubblico da investitori e alleati interni. Fu una svolta nel modo in cui i partiti si procuravano i fondi. Nel 1976, la Corte Suprema stabilì nel caso Buckley contro Valeo che le spese elettorali rientravano nella “libertà di parola”, rendendo legalmente ammissibile il denaro nero per le campagne elettorali. Poi, nel 1982, la Commissione Hunt codificò i superdelegati preselezionati come parte del processo delle primarie democratiche, isolando ulteriormente le élite del partito dal pubblico.

Mentre i Democratici si riorganizzavano, i Repubblicani elaborarono strategie per aggirare il crescente numero di astenuti. Nel 1977, fecero ostruzionismo fino a rendere irrilevante il disegno di legge del Presidente Jimmy Carter per facilitare la registrazione degli elettori. Come affermò Pat Buchanan, futuro direttore della comunicazione della Casa Bianca per il Presidente Reagan: “Il trasporto in autobus di parassiti economici e analfabeti politici” alle urne avrebbe significato la fine della Nuova Destra insorta.

Consulenti e sondaggisti divennero invece un gruppo dirigente all’interno dell’apparato del partito, ormai privo di solide radici nella società civile. Secondo il politologo Costas Panagopoulos, le menzioni mediatiche della consulenza politica aumentarono di 13 volte dal 1979 al 1985. Il mantenimento del cartello del partito divenne un fine in sé per i suoi dipendenti, e la politica di conseguenza si trasformò nell’arte di mantenere questo mondo chiuso.

Il risultato fu lo sviluppo di una “campagna permanente”, come la definì il celebre stratega politico Sidney Blumenthal nel 1980. I costi crescenti della campagna permanente erano semplicemente troppo alti per consentire l’ingresso di eventuali outsider. In molti casi, essere un candidato in carica era la chiave per vittorie praticamente automatiche. Una volta entrati nel sistema dei partiti, si rimaneva. Di conseguenza, gli Stati Uniti sono diventati di fatto una gerontocrazia.

Nonostante entrambi i partiti politici abbiano costruito fossati attorno a sé stessi per decenni, sono ancora oggi sotto assedio. Nel XXI secolo, la sfiducia di lunga data si è trasformata in un’opposizione generalizzata, alimentata da Internet. Come risvegliata dal letargo, l’opinione pubblica, un tempo passiva, ha fatto sentire il suo potere. Sia Barack Obama che Donald Trump hanno vinto, pur non essendo stati scelti dalle primarie invisibili.

Eppure, l’antipolitica contemporanea ci presenta una contraddizione lampante, sia negli Stati Uniti che altrove. Mentre gli outsider sfruttano il sentimento anti-establishment per ottenere voti, faticano a mantenere la legittimità una volta saliti al potere. Questo perché l’antipolitica oggi raramente si esprime come un programma positivo.

Poiché non esiste una chiara opinione di maggioranza che la guidi, se non un generale cinismo, ciò che abbiamo invece è un “populismo impopolare”. E come spesso accade, eleggere un nuovo governo non attenua sostanzialmente la tensione; la attenua solo brevemente.Un’opposizione generale

Più di mezzo secolo fa, il teorico politico americano Robert Dahl ipotizzò che il futuro politico potesse essere motivato da un nuovo principio: “un’opposizione al leviatano democratico stesso”. Per il cittadino medio alienato, lo Stato sarebbe diventato “remoto, distante e impersonale”. Dahl, per molti versi, aveva ragione.

La vita politica odierna è dominata da un generale malcontento nei confronti della rappresentanza stessa. Ma questo è più vicino a svelare la vera realtà della politica di quanto si possa immaginare.

Non si può essere nostalgici delle passate epoche della politica di massa, come se fossero state effettivamente rappresentative. Al contrario, quelle epoche hanno oscurato il reale rapporto tra Stato e cittadini. A quei tempi, dopotutto, potenti macchine politiche facevano affidamento sui dirigenti delle organizzazioni della società civile per sfornare voti.

Questa configurazione passata era leggermente più rappresentativa e a volte ha persino prodotto risultati, ma il pubblico americano la rifiutò negli anni ‘70 proprio perché si rivelava corrotta. Internet ha ora trasformato questo cinismo di lunga data in un malcontento allo stato puro. Il palese interesse personale dello Stato è ora palesemente allo scoperto, visto per quello che è.

Per quanto disordinato possa essere, ciò che è stato distrutto non può essere ricomposto. Quando l’antipolitica è l’umore prevalente, la divisione più rilevante diventa quella tra alto e basso, tra insider e outsider. Ciò che più detesta la gente è essere resi invisibili.

Qualsiasi movimento futuro di successo dovrà posizionarsi come parte integrante del pubblico e dimostrare di poter produrre risultati pro-sociali e materiali. Una società civile più sana deve essere ricostruita dal basso. Pur mancando di coerenza, l’antipolitica è di fatto il vero movimento: sintomo di una profonda frattura che non può più essere ignorata”.

“Più dell’affetto contano le relazioni, la capacità e la disponibilità all’ascolto, la disponibilità a cambiare opinioni e se stessi e l’impegno a creare atmosfere emotive familiari utili al dialogo, alla tolleranza e allo scambio intergenerazionale.

“Più dell’affetto contano le relazioni, la capacità e la disponibilità all’ascolto, la disponibilità a cambiare opinioni e se stessi e l’impegno a creare atmosfere emotive familiari utili al dialogo, alla tolleranza e allo scambio intergenerazionale. Le vite virtuali nelle quali molti ragazzi sono immersi sono vissute all’interno di spazi sociali e relazionali come Facebook, Linkedin, YouTube, Google Plus, Twitter, Pinterest, Instagram e altri spazi online simili. La frequentazione di questi spazi è motivata principalmente dalla necessità di attivare e coltivare nel tempo nuove relazioni e di rafforzare quelle già esistenti nella vita reale. Il modo con cui la relazione è sperimentata è attraverso comunicazioni testuali o scambio di immagini, foto e altri contenuti digitali. Il fatto che i ragazzi sperimentino numerose forme di relazione non significa automaticamente che esse siano salutari, di qualità, intime come quelle reali. Fortunatamente queste relazioni non escludono quelle faccia a faccia ma possono essere a volte nocive e fonte di rischi e pericoli nelle molteplici vite online vissute dai ragazzi.

Le vite virtuali nelle quali molti ragazzi sono immersi sono vissute all’interno di spazi sociali e relazionali come Facebook, Linkedin, YouTube, Google Plus, Twitter, Pinterest, Instagram e altri spazi online simili. La frequentazione di questi spazi è motivata principalmente dalla necessità di attivare e coltivare nel tempo nuove relazioni e di rafforzare quelle già esistenti nella vita reale. Il modo con cui la relazione è sperimentata è attraverso comunicazioni testuali o scambio di immagini, foto e altri contenuti digitali. Il fatto che i ragazzi sperimentino numerose forme di relazione non significa automaticamente che esse siano salutari, di qualità, intime come quelle reali. Fortunatamente queste relazioni non escludono quelle faccia a faccia ma possono essere a volte nocive e fonte di rischi e pericoli nelle molteplici vite online vissute dai ragazzi. sociali

sociali Il genitore non è il solo educatore e responsabile dello sviluppo dei ragazzi. Un ruolo importante è giocato dagli insegnanti che li incontrano e li seguono nei vari gradi e livelli scolastici. La tecnologia è entrata prepotentemente anche a scuola evidenziando ancor più la diversità tra nativi e immigrati digitali. Molti professori sono entrati nei social network ma pochi li usano per relazionarsi realmente con i loro studenti rispecchiando il loro profilo professionale di insegnanti ed educatori.

Il genitore non è il solo educatore e responsabile dello sviluppo dei ragazzi. Un ruolo importante è giocato dagli insegnanti che li incontrano e li seguono nei vari gradi e livelli scolastici. La tecnologia è entrata prepotentemente anche a scuola evidenziando ancor più la diversità tra nativi e immigrati digitali. Molti professori sono entrati nei social network ma pochi li usano per relazionarsi realmente con i loro studenti rispecchiando il loro profilo professionale di insegnanti ed educatori.